Information theory (ทฤษฎีสารสนเทศ) ถูกสร้างขึ้นโดย C.E. Shannon ในปลายทศวรรษ 1940. ผู้บริหารของ Bell Telephone Labs ต้องการให้เขาเรียกมันว่า “communication theory” ซึ่งเป็นชื่อที่ถูกต้องกว่า แต่ด้วยเหตุผลด้านการประชาสัมพันธ์ Shannon เลือกใช้คำว่า “information theory” และชื่อนั้นก็เป็นที่รู้จักมาจนถึงปัจจุบัน ชื่อเรื่องบอกว่าสาขานี้เกี่ยวกับข้อมูล — ดังนั้นจึงดูเหมือนสำคัญ เมื่อเราเข้าสู่ยุคสารสนเทศมากขึ้นเรื่อยๆ

ดังนั้น ผมจะสรุปผลสำคัญบางประการ โดยไม่เน้นการพิสูจน์เชิงทั่วไปอย่างเข้มงวด แต่เป็นการให้เหตุผลเชิงสัญชาตญาณในกรณีพิเศษ เพื่อให้คุณเข้าใจว่า information theory คืออะไร และมันสามารถหรือไม่สามารถทำอะไรให้คุณได้ ก่อนอื่น “information” คืออะไร? Shannon ระบุว่า information ตรงกับ surprise (ความประหลาดใจ). เขาเลือกให้ค่าปริมาณข้อมูลเป็นค่าลบของลอการิทึมของความน่าจะเป็นของเหตุการณ์ เมื่อเหตุการณ์ที่มีความน่าจะเป็น p เกิดขึ้น ตัวอย่างเช่น ถ้าผมบอกว่ามีหมอกควันใน Los Angeles p จะใกล้ 1 และนั่นไม่ใช่ข้อมูลมากนัก แต่ถ้าผมบอกว่าฝนตกที่ Monterey ในเดือนมิถุนายน นั่นกลับน่าประหลาดใจและให้ข้อมูลมากกว่า เนื่องจาก log 1 = 0 เหตุการณ์ที่แน่นอนจึงไม่มีข้อมูล

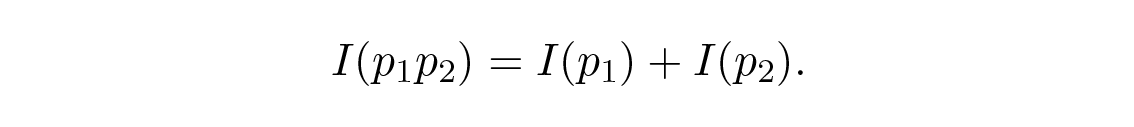

ในรายละเอียด Shannon เห็นว่ามาตรวัดปริมาณข้อมูลควรเป็นฟังก์ชันต่อเนื่องของความน่าจะเป็น p ของเหตุการณ์ และสำหรับเหตุการณ์ที่เป็นอิสระกันมันควรมีคุณสมบัติการบวก — สิ่งที่คุณเรียนรู้จากแต่ละเหตุการณ์ อิสระ เมื่อรวมกันแล้วควรเท่ากับสิ่งที่คุณเรียนรู้จากเหตุการณ์รวม ตัวอย่างเช่น ผลการทอยลูกเต๋าและการโยนเหรียญมักถือว่าเป็นเหตุการณ์อิสระ ในสัญลักษณ์ทางคณิตศาสตร์ ถ้า I(p) คือปริมาณข้อมูลของเหตุการณ์ที่มีความน่าจะเป็น p สำหรับเหตุการณ์ x ที่มีความน่าจะเป็น p_1 และเหตุการณ์อิสระ _y ที่มีความน่าจะเป็น p_2 แล้วสำหรับเหตุการณ์ทั้ง _x และ y เราจะได้ว่า

สรุป: This is a functional equation, true for all _p_1 and _p_2.

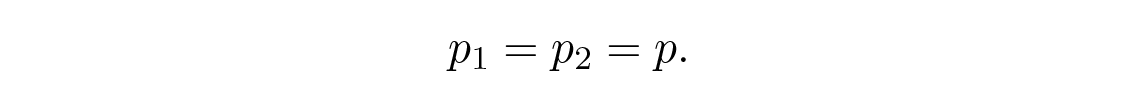

เพื่อแก้สมการฟังก์ชันนี้ ให้สมมติว่า

จากนั้นจะได้ว่า

สรุป: If p_1 = _p_2 and _p_2 = _p, then

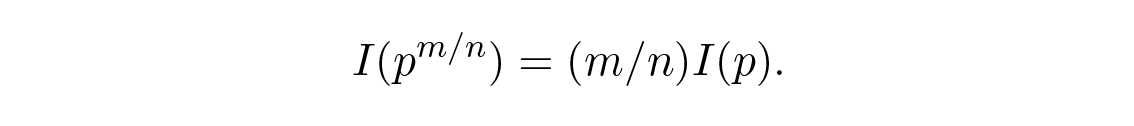

อื่นๆ ต่อไปได้ โดยขยายกระบวนการนี้ คุณจะสามารถแสดงได้ โดยวิธีมาตรฐานที่ใช้กับเลขชี้กำลัง สำหรับทุกรูปเศษ m/n ว่า

สรุป: From the assumed continuity of the information measure, it follows the log is the only continuous solution to the functional equation from earlier.

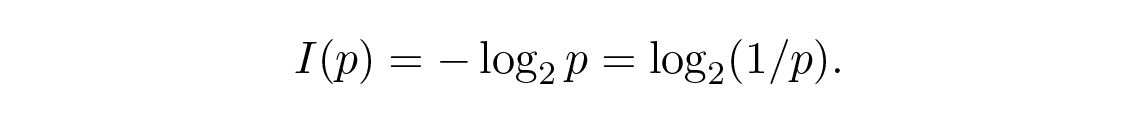

ในทฤษฎีสารสนเทศ มักนิยมใช้ฐานลอการิทึมเป็น 2 ดังนั้นการเลือกระหว่างสองทางเลือกจึงเท่ากับหนึ่ง bit ของข้อมูล ดังนั้นปริมาณข้อมูลจึงถูกวัดโดยสูตร

สรุป: Let us pause and examine what has happened so far. First, we have not defined “information.” We merely gave a formula for measuring the amount. Second, the measure depends on surprise, and while it does match, to a reasonable degree, the situation with machines, say the telephone system, radio, television, computers, and such, it simply does not represent the normal human attitude towards information. Third, it is a relative measure since it depends on the state of your knowledge. If you are looking at a stream of “random numbers” from a random source, then you think each number comes as a surprise, but if you know the formula for computing the “random numbers,” then the next number contains no surprise at all and hence contains no information! Thus, while the definition Shannon made for information is appropriate in many respects for machines, it does not seem to fit the human use of the word. This is the reason it should have been called “communication theory” and not “information theory.” It is too late to undo the definition (which produced so much of its initial popularity, and still makes people think it handles “information”), so we have to live with it, but you should clearly realize how much it distorts the common view of information and deals with something else, which Shannon took to be surprise.

นี่เป็นประเด็นที่ต้องพิจารณาเมื่อมีการเสนอคำนิยามใหม่ๆ เช่น คำนิยามของ Shannon เกี่ยวกับ information ว่าสอดคล้องกับแนวคิดดั้งเดิมของคุณเพียงใดและแตกต่างอย่างไร เกือบจะไม่มีคำนิยามใดที่ตรงกับความเข้าใจเชิงสัญชาตญาณของคุณอย่างสมบูรณ์ แต่ในระยะยาวคำนิยามต่างหากที่กำหนดความหมายของแนวคิด ดังนั้นการนิยามอย่างชัดจึงมักสร้างการบิดเบือนบางประการ

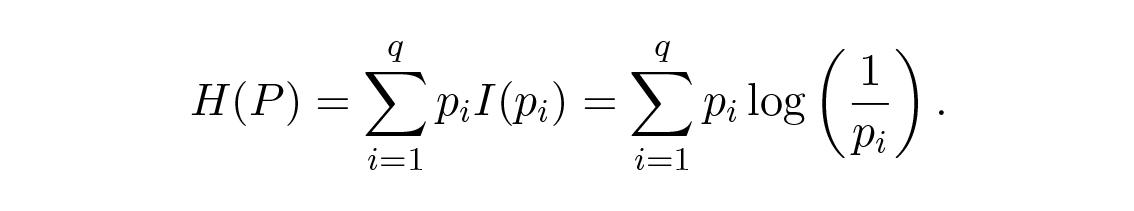

สรุป: Given an alphabet of q symbols with probabilities p_i, then _the average amount of information (the expected value) in the system is

นี่เรียกว่า the entropy ของระบบที่มีการแจกแจงความน่าจะเป็น {_p_i} คำว่า “entropy” ถูกนำมาใช้เพราะรูปแบบคณิตศาสตร์เดียวกันปรากฏในอุณหพลศาสตร์และกลศาสตร์สถิติ ดังนั้นคำว่า “entropy” จึงให้ความรู้สึกว่าสำคัญซึ่งในระยะยาวก็อาจถูกยกย่องเกินจริง รูปแบบทางคณิตศาสตร์เดียวกันไม่ได้หมายความว่าการตีความสัญลักษณ์จะเหมือนกันเสมอไป!

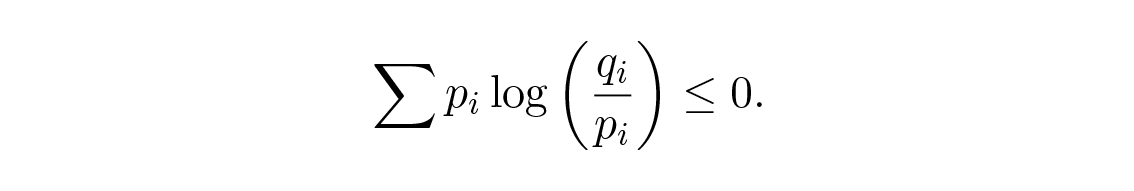

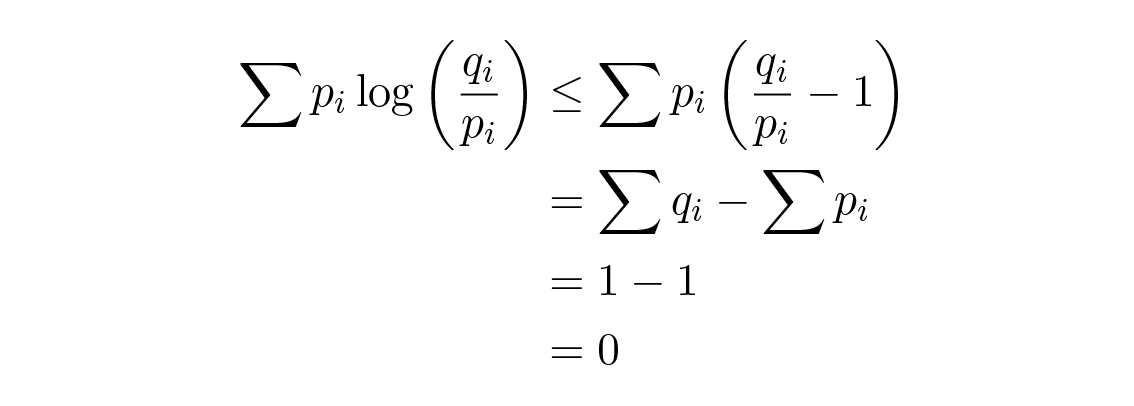

ความเอนโทรปีของการแจกแจงความน่าจะเป็นมีบทบาทสำคัญในทฤษฎีการเข้ารหัส ผลลัพธ์สำคัญอย่างหนึ่งคือ Gibbs’ inequality สำหรับการแจกแจงความน่าจะเป็นสองชุด p_i และ q_i เราต้องพิสูจน์

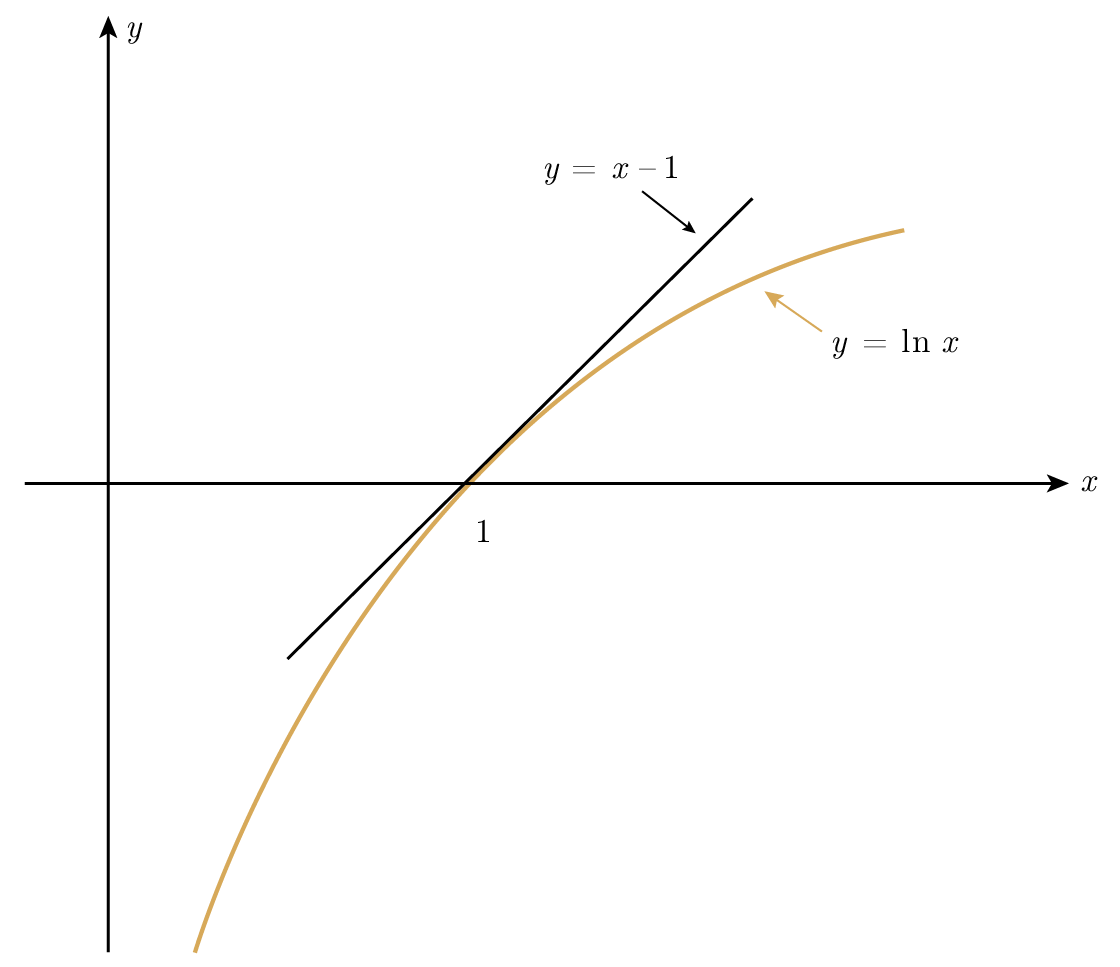

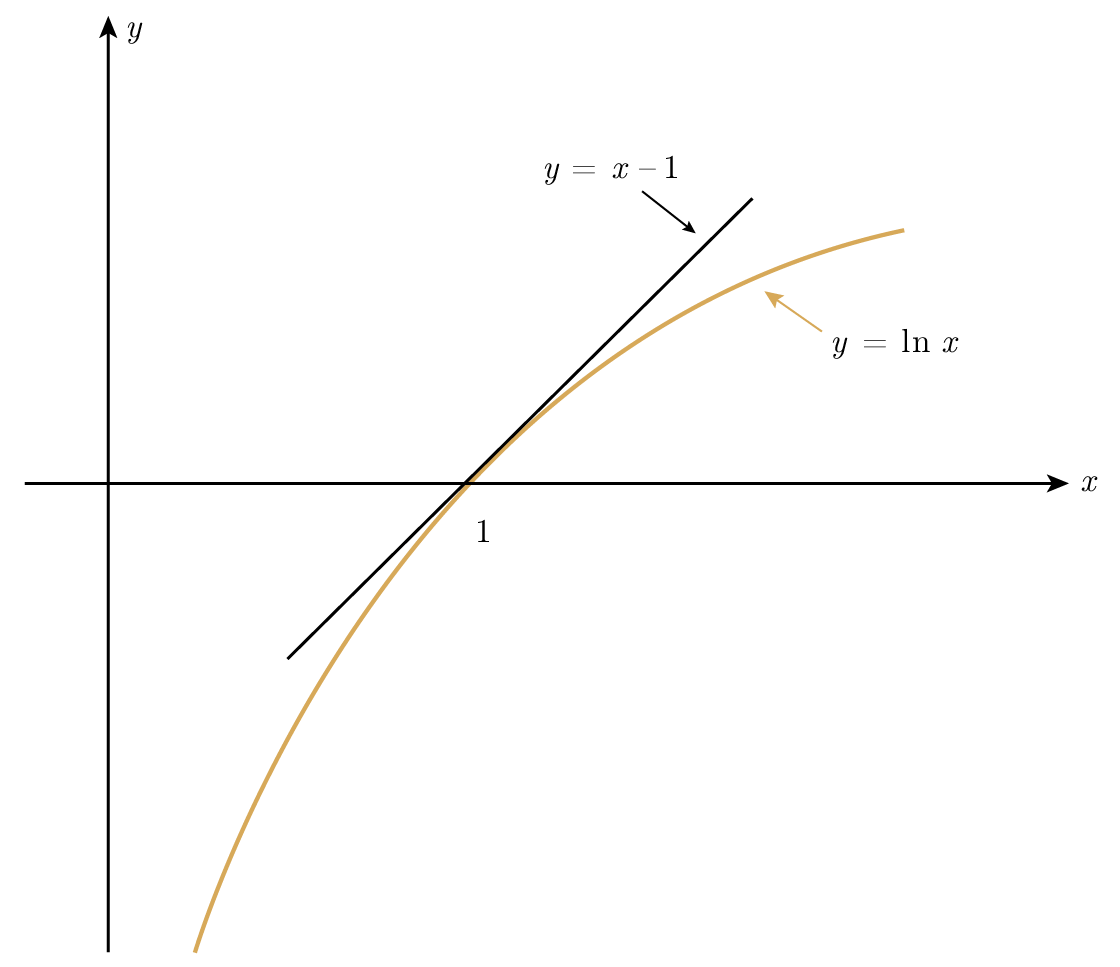

สรุป:  Figure 13.1—Log inequality

Figure 13.1—Log inequality

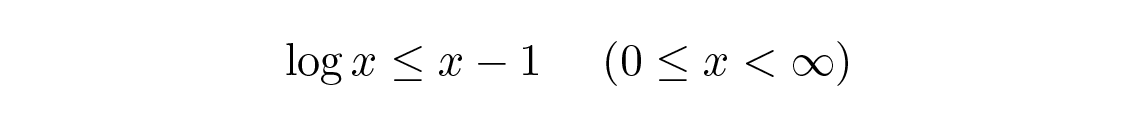

การพิสูจน์ตั้งอยู่บนภาพที่ชัดเจน Figure 13.1 ว่า

และความเท่ากันเกิดขึ้นก็ต่อเมื่อ x = 1 การประยุกต์อสมการนี้กับผลรวมข้างต้นจะให้ผลดังต่อไปนี้

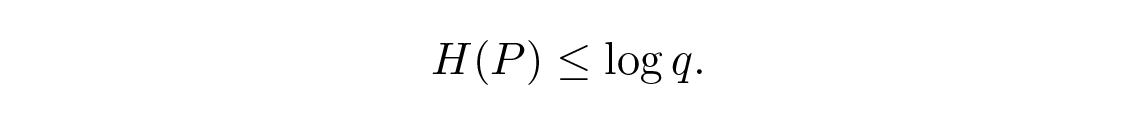

ถ้ามี q สัญลักษณ์ในระบบสัญญาณ โดยเลือก q_i = 1/_q เราจะได้จากอสมการของ Gibbs โดยย้ายสมาชิกที่เป็น q ว่า

สรุป: This says that in a probability distribution, if all the q symbols are of equal probability, 1/q, then the maximum entropy is exactly ln q, and otherwise the inequality holds.

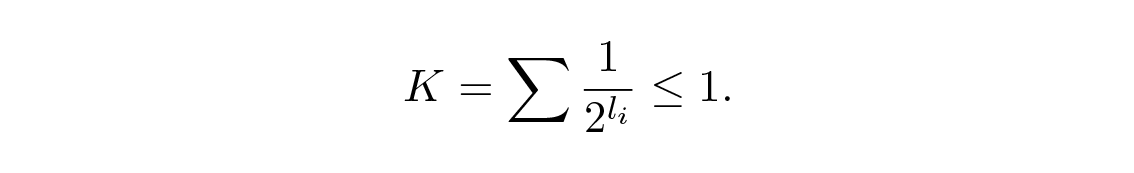

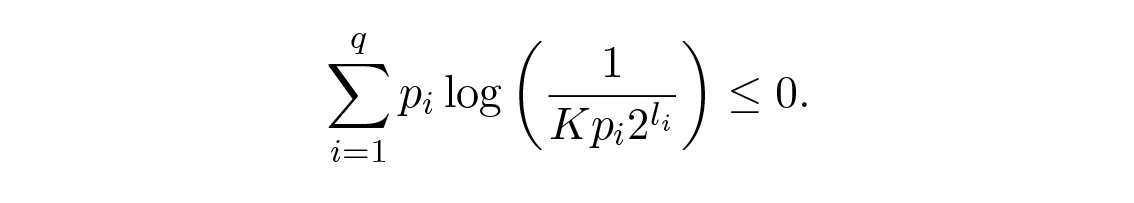

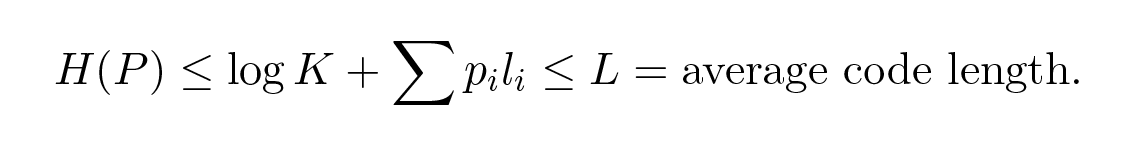

เมื่อให้โค้ดที่ถอดรหัสได้เพียงแบบเดียว (uniquely decodable code) เรามีอสมการของ Kraft,

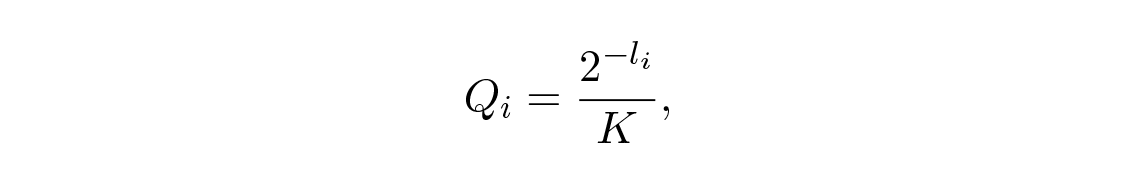

ถ้าเรากำหนด pseudo-probabilities ดังนี้

สรุป: where of course Σ[_Q_i] = 1, it follows from Gibbs’ inequality that

สรุป: Then after some algebra (remember that K ≤ 1, so we can drop the log term and perhaps strengthen the inequality further):

ดังนั้นเอนโทรปีเป็นขอบล่างสำหรับการเข้ารหัสใดๆ ต่อสัญลักษณ์สำหรับความยาวเฉลี่ยของโค้ด L นี่คือ noiseless coding theorem of Shannon

ตอนนี้เรามาดูบทนิยามหลักเกี่ยวกับขอบเขตของระบบสัญญาณ ซึ่งใช้การเข้ารหัสสตรีมบิตที่เป็นอิสระและทำทีละสัญลักษณ์ in the presence of noise หมายความว่ามีความน่าจะเป็นที่บิตหนึ่งจะถูกส่งถูกต้องคือ P > 1/2 และความน่าจะเป็นที่มันถูกเปลี่ยนคือ Q = 1 – P เพื่อความสะดวก สมมติว่า error แต่ละบิตเป็นอิสระและมีความเป็นไปได้เท่ากัน เรียกว่า “white noise”

สรุป: We will encode a long stream of n bits into one encoded message, the n_th extension of a one-bit code, where the _n is to be determined as the theory progresses. We regard the message of n bits as a point in an n-dimensional space. Since we have an n_th extension, for simplicity we will assume each message has the same probability of occurring, and we will assume there are _M messages (M also to be determined later), hence the probability of each initial message is 1/M.

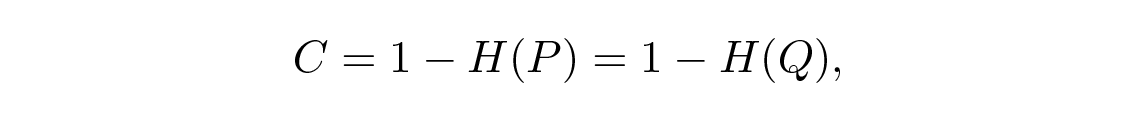

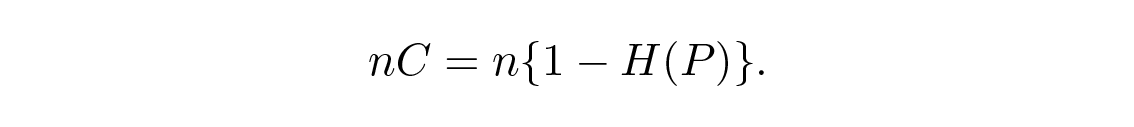

ต่อไปเรามาดูแนวคิดของ channel capacity โดยสรุป channel capacity ถูกนิยามว่าเป็นปริมาณข้อมูลสูงสุดที่สามารถส่งผ่านช่องทางได้อย่างเชื่อถือได้ โดยพิจารณาสูงสุดเหนือการเข้ารหัสทั้งหมด ดังนั้นไม่มีข้อโต้แย้งว่ามีข้อมูลมากกว่าที่ความจุช่องทางจะให้ได้ สามารถพิสูจน์ได้สำหรับ binary symmetric channel (ซึ่งเราใช้) ว่าความจุ C ต่อบิตถูกกำหนดโดย

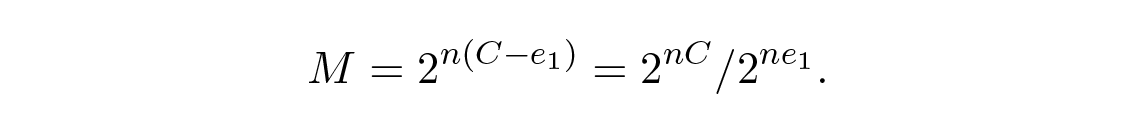

สรุป: where, as before, P is the probability of no error in any bit sent. For the n independent bits sent we will have the channel capacity

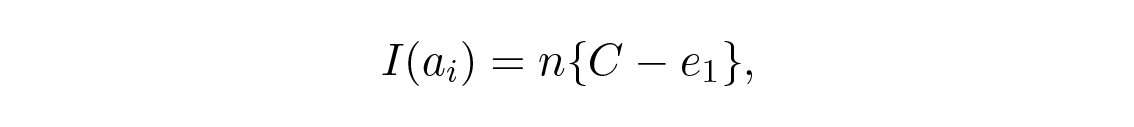

ถ้าเราจะอยู่ใกล้ความจุของช่องทาง เราต้องส่งข้อมูลเกือบเท่าจำนวนนั้นสำหรับสัญลักษณ์แต่ละตัว a_i, i = 1, …, M โดยทุกตัวมีความน่าจะเป็น 1/M และเราต้องมี

สรุป: when we send any one of the M equally likely messages _a_i. We have, therefore:

ด้วย n บิตเราคาดว่าจะมี nQ ข้อผิดพลาด ในทางปฏิบัติ สำหรับข้อความที่ส่ง n บิต จะมีประมาณ nQ ข้อผิดพลาดในข้อความที่รับ สำหรับ n ขนาดใหญ่การกระจายสัมพัทธ์ (spread = ความกว้าง ซึ่งคือรากที่สองของความแปรปรวน) ของจำนวนข้อผิดพลาดจะแคบลงเมื่อ n เพิ่มขึ้น

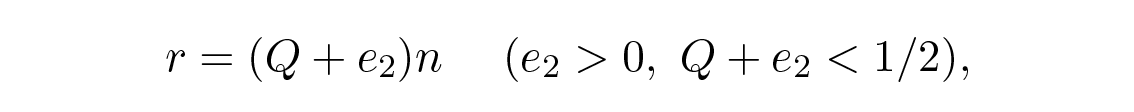

จากมุมมองของผู้ส่ง ผมถือว่าข้อความ a_i จะถูกส่งและวาดทรงกลมล้อมรอบมันที่รัศมี

สรุป: which is slightly larger by e_2 than the expected number of errors, _Q, Figure 13.2. If n is large enough, then there is an arbitrarily small probability of there occurring a received message point b_j which falls outside this sphere. Sketching the situation as seen by me, the sender, we have along any radii from the chosen signal, _a_i, to the received message, _b_j, with the probability of an error is (almost) a normal distribution, peaking up at _nQ, and with any given e_2 there is an _n so large the probability of the received point, _b_j, falling outside my sphere is as small as you please.

Figure 13.2—ผู้ส่ง

สรุป:  Figure 13.3—Receiver

Figure 13.3—Receiver

ตอนนี้ เมื่อมองจากฝั่งคุณ Figure 13.3 ในฐานะผู้รับ จะมีทรงกลม S(r) ที่มีรัศมีเท่ากันรอบจุดที่รับ b_i ในพื้นที่ เช่น ถ้าข้อความที่รับ b_i อยู่ภายในทรงกลมของผม ต้นฉบับ a_i ที่ผมส่งก็จะอยู่ภายในทรงกลมนั้นของคุณ

สรุป: How can an error arise? An error can occur according to the following table.

| กรณี | a_i อยู่ใน S(r) | อีกจุดอยู่ใน S(r) | ความหมาย |

|---|---|---|---|

| 1 | ใช่ | ใช่ | ข้อผิดพลาด |

| 2 | ใช่ | ไม่ใช่ | ไม่มีข้อผิดพลาด |

| 3 | ไม่ใช่ | ใช่ | |

| 4 | ไม่ใช่ | ไม่ใช่ | ข้อผิดพลาด |

สรุป: Here we see that if there is at least one other original message point in the sphere about your received point then it is an error, since you cannot decide which one it is. The sent message is correct only if the sent point is in the sphere and there is no other code point in it.

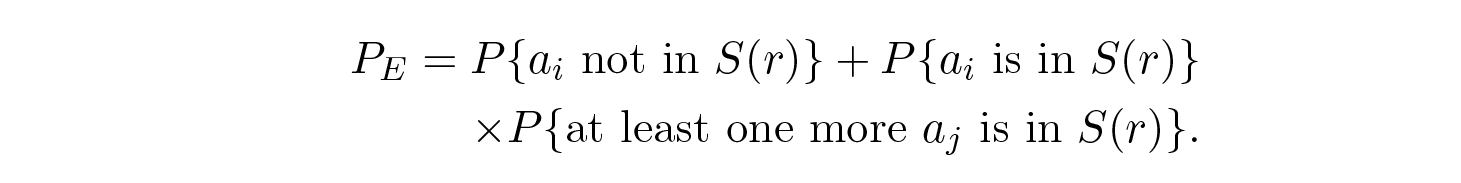

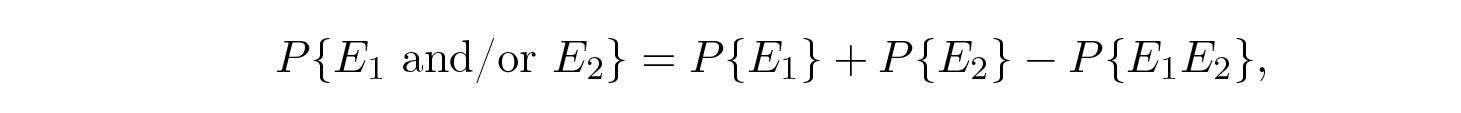

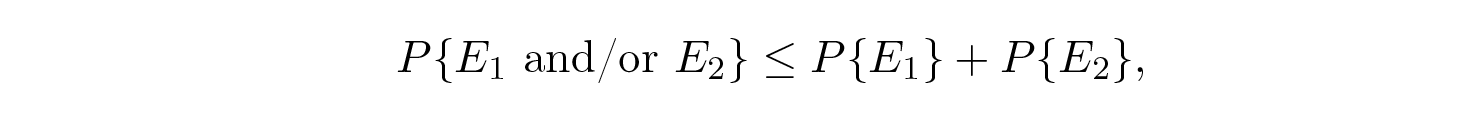

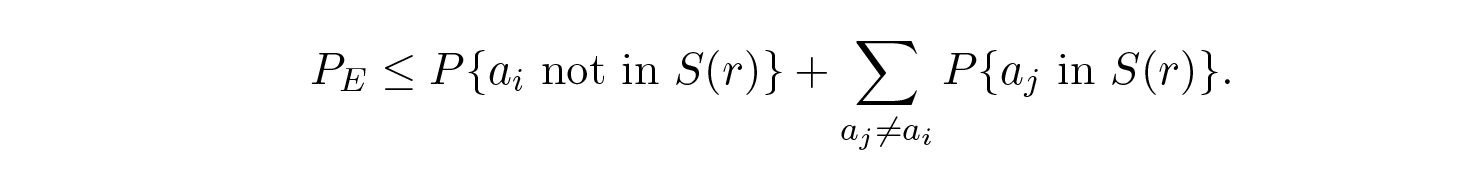

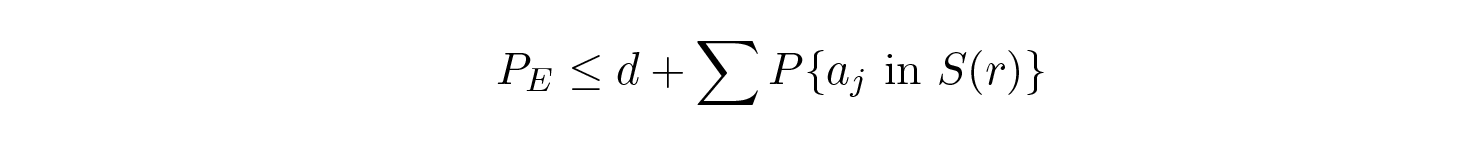

ดังนั้น เราจึงได้สมการทางคณิตศาสตร์สำหรับความน่าจะเป็น P_E ของข้อผิดพลาด หากข้อความที่ส่งคือ a_i:

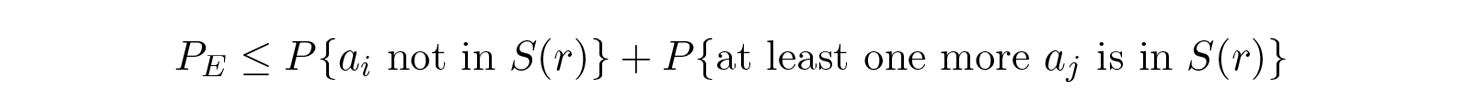

เราสามารถละเทอมตัวแรกในพจน์ที่สองโดยตั้งค่าเป็น 1 เพื่อให้ได้อสมการ:

แต่โดยใช้ข้อเท็จจริงที่ชัดเจน

ดังนั้น

สรุป: applied repeatedly to the last term on the right gives

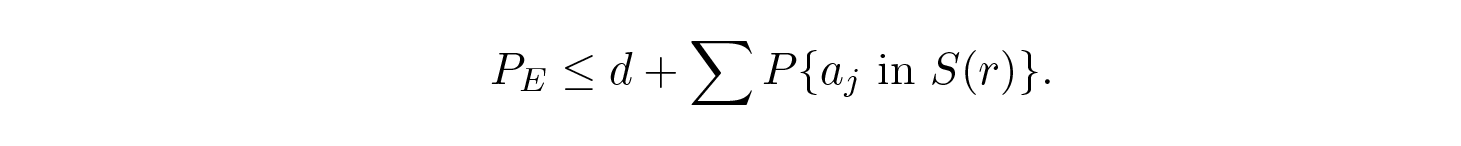

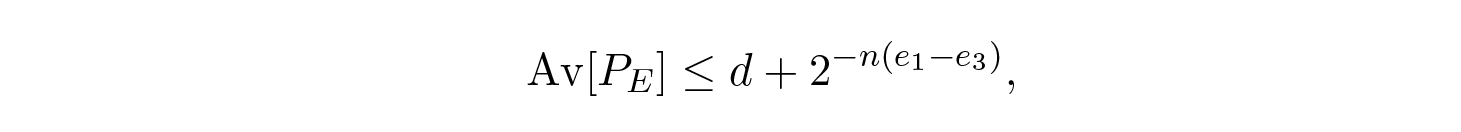

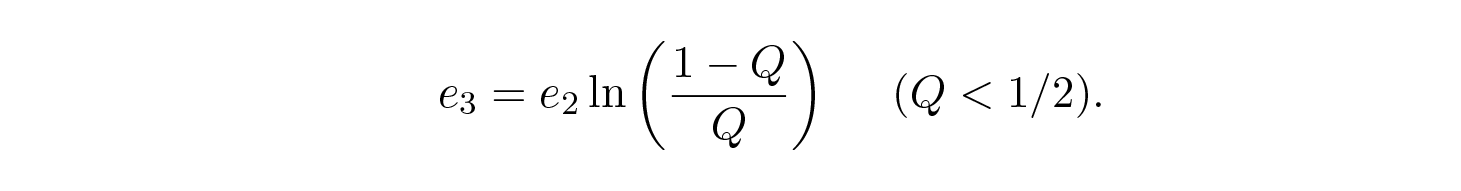

โดยการทำให้ n ใหญ่พอ เทอมแรกสามารถถูกทำให้เล็กเท่าที่เราต้องการ เช่น น้อยกว่าจำนวน d บางค่า ดังนั้นเราจะได้ว่า

สรุป: We now examine how we can make the code book for the encoding of the M messages, each of n bits. Not knowing how to encode, error-correcting codes not having been invented as yet, Shannon chose a random encoding. Toss a penny for each bit of the n bits of a message in the code book, and repeat for all M messages. There are nM tosses, hence 2nM possible code books, all books being of the same probability 1/2nM. Of course the random process of making the code book means there is a chance there will be duplicates, and there may be code points which are close to each other and hence will be a source of probable errors. What we have to prove is this does not occur with a probability above any positive small level of error you care to pick—provided n is made large enough.

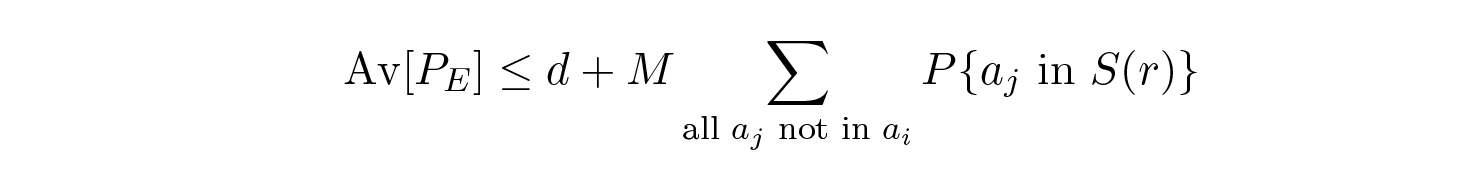

ขั้นตอนสำคัญคือ Shannon ได้ เฉลี่ยทั่วสมุดรหัสที่เป็นไปได้ทั้งหมด เพื่อหาค่าเฉลี่ยของข้อผิดพลาด! เราจะใช้สัญลักษณ์ Av[·] เพื่อหมายถึงค่าเฉลี่ยเหนือชุดสมุดรหัสสุ่มที่เป็นไปได้ทั้งหมด การเฉลี่ยค่าคงที่ d จะให้ค่าคงที่ และเนื่องจากสำหรับค่าเฉลี่ยแต่ละพจน์เหมือนกันกับพจน์อื่น ๆ ในผลรวม

สรุป: which can be increased (M – 1 goes to M):

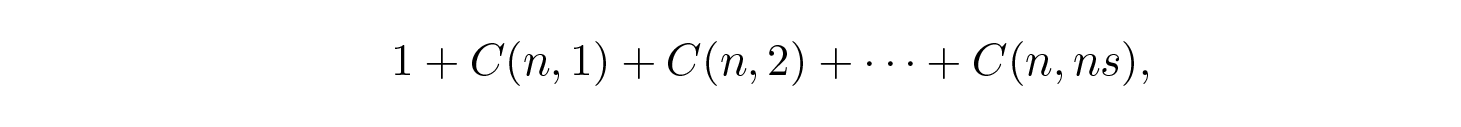

สำหรับข้อความใด ๆ เมื่อเราเฉลี่ยเหนือสมุดรหัสทั้งหมด การเข้ารหัสจะวิ่งผ่านค่าทั้งหมดที่เป็นไปได้ ดังนั้นความน่าจะเป็นเฉลี่ยที่จุดอยู่ในทรงกลมคืออัตราส่วนของปริมาตรของทรงกลมต่อปริมาตรทั้งหมดของพื้นที่ ปริมาตรของทรงกลมคือ

สรุป: where s = Q + e_2 < 1/2, and _ns is supposed to be an integer.

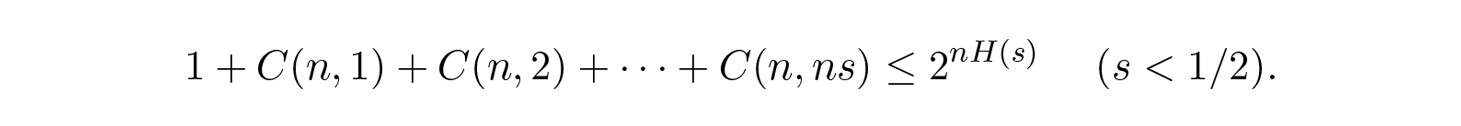

พจน์ที่ใหญ่ที่สุดในผลรวมนี้คือพจน์สุดท้าย (ด้านขวา) เราประมาณขนาดของมันโดยใช้สูตรสเตอริลลิง (Stirling) สำหรับแฟกทอเรียล จากนั้นเราดูอัตราการตกลงไปยังพจน์ถัดไปทางซ้าย สังเกตว่าอัตรานี้เพิ่มขึ้นเมื่อเลื่อนไปทางซ้าย และดังนั้นเราสามารถ: (1) ครอบงำ ผลรวมด้วยลำดับเรขาคณิตโดยใช้อัตราเริ่มต้นนี้ จากนั้น (2) ขยายลำดับเรขาคณิตจาก ns พจน์เป็นจำนวนอนันต์ (3) ผลรวมลำดับเรขาคณิตอนันต์ (ทั้งหมดเป็นพีชคณิตมาตรฐานไม่สำคัญมาก) และสุดท้าย (4) เราได้ขอบเขต (สำหรับ n ใหญ่พอ):

สังเกตว่า entropy H(s) ปรากฏในอัตลักษณ์แบบทวินาม

สรุป: We have now to assemble the parts; note the Taylor series expansion of H(s) = H(Q + _e_2) gives a bound when you take only the first derivative term and neglect all others, to get the final expression

โดยที่

สรุป: All we have to do now is pick an e_2 so _e_3 < _e_1, and the last term will get as small as you please with sufficiently large _n. Hence the average value of P_E can be made as small as you please while still being as close to channel capacity _C as you please.

ถ้าค่าเฉลี่ยเหนือสมุดรหัสทั้งหมดมีข้อผิดพลาดเล็กพอ แสดงว่าต้องมีสมุดรหัสอย่างน้อยหนึ่งเล่มที่เหมาะสม — ดังนั้นจะต้องมีระบบเข้ารหัสที่เหมาะสมอย่างน้อยหนึ่งระบบ นี่คือผลสำคัญของ Shannon คือ “noisy coding theorem” ถึงกระนั้นควรสังเกตว่าเขาพิสูจน์ในความเป็นทั่วไปกว่าช่องทางสมมาตรแบบไบนารีที่ผมใช้ แต่อัลกอริทึมคณิตศาสตร์จะซับซ้อนกว่าในกรณีทั่วไป แต่แนวคิดไม่ได้แตกต่างกันมาก ดังนั้นกรณีพิเศษที่ใช้อธิบายก็เพียงพอที่จะเผยให้เห็นลักษณะแท้จริงของทฤษฎี

สรุป: Let us critique the result. Again and again we said, “For sufficiently large n.” How large is this n? Very, very large indeed if you want to be both close to channel capacity and reasonably sure you are right! So large, in fact, you would probably have to wait a very long time to accumulate a message of that many bits before encoding it, let alone the size of the random code books (which, being random, cannot be represented in a significantly shorter form than the complete listing of all Mn bits, both M and n being very large).

รหัสแก้ไขข้อผิดพลาด (error-correcting codes) หลีกเลี่ยงการต้องรอข้อความยาวมากและเข้ารหัสด้วยสมุดรหัสขนาดใหญ่พร้อมสมุดถอดรหัสขนาดใหญ่ เพราะพวกมันเลี่ยงสมุดรหัสแบบสุ่มและใช้วิธีที่เป็นแบบแผน (คำนวณได้) ในทฤษฎีอย่างง่ายพวกมันมักเสียความสามารถในการเข้าใกล้ความจุช่องทางมากในขณะที่ยังรักษาอัตราข้อผิดพลาดให้ต่ำตามต้องการ แต่เมื่อรหัสสามารถแก้ไขข้อผิดพลาดจำนวนมากได้ มันก็ทำงานได้ดี กล่าวอีกนัยหนึ่ง หากคุณจัดสรรความจุสำหรับระดับการแก้ไขข้อผิดพลาด เพื่อให้มีประสิทธิภาพคุณต้องใช้ความสามารถนี้บ่อยๆ มิฉะนั้นความจุจะถูกใช้เปล่า และนั่นแปลว่าต้องแก้ไขข้อผิดพลาดจำนวนมากในแต่ละข้อความที่ส่ง

แต่ทฤษฎีนี้ไม่ได้ไร้ประโยชน์! มันแสดงว่าในแง่ที่เกี่ยวข้องแล้ว วิธีการเข้ารหัสที่มีประสิทธิภาพต้องมีการเข้ารหัสที่ซับซ้อนสำหรับสตริงบิตยาวมาก เราเห็นสิ่งนี้ในดาวเทียมที่ผ่านดาวเคราะห์นอกระบบ พวกมันแก้ไขข้อผิดพลาดต่อบล็อกมากขึ้นเมื่อต้องไกลขึ้นจากโลกและดวงอาทิตย์ (ซึ่งบางดวงมีพลังงานสุริยะประมาณ 5 วัตต์; บางดวงใช้แหล่งพลังงานนิวเคลียร์มีกำลังในระดับใกล้เคียง) พวกมันต้องใช้รหัสแก้ไขข้อผิดพลาดระดับสูงเพื่อให้ทำงานได้ดี ภายใต้พลังงานที่ต่ำ ขนาดจานขนาดเล็ก ขนาดจานรับสัญญาณบนโลกที่จำกัด และระยะทางอันไกลโพ้นที่สัญญาณต้องเดินทาง

เรากลับไปที่พื้นที่มิติ n ที่เราใช้ในการพิสูจน์ ในการอภิปรายเรื่องพื้นที่มิติ n เราแสดงให้เห็นว่าเกือบทุกปริมาตรของทรงกลมอยู่ใกล้พื้นผิวด้านนอก — ดังนั้นสำหรับทรงกลมที่ขยายขึ้นเพียงเล็กน้อยรอบสัญญาณที่รับ จะใกล้แน่นอนว่าจุดสัญญาณต้นทางอยู่ภายใน ดังนั้นการแก้ไขข้อผิดพลาดจำนวนมาก nQ ให้เหลือเกือบไม่มีข้อผิดพลาดหลังถอดรหัสจึงไม่แปลกใจ สิ่งที่น่าประหลาดใจยิ่งขึ้นคือทรงกลม M สามารถถูกจัดวางโดยเกือบไม่มีการทับซ้อนอีกครั้ง การทับซ้อนเล็กน้อยตามที่ต้องการก็เพียงพอ คำอธิบายว่าทำไมเป็นไปได้มาจากการตรวจสอบ channel capacity ให้ละเอียดกว่าที่เราทำไป แต่คุณเห็นว่ากำรอเข้ารหัสแก้ไขข้อผิดพลาดแบบ Hamming ทรงกลมไม่มีการทับซ้อน การมีทิศทางที่เกือบตั้งฉากหลายทิศในพื้นที่มิติ n อธิบายว่าทำไมเราจึงสามารถบรรจุทรงกลม M ลงไปในพื้นที่ได้โดยมีการทับซ้อนน้อย โดยยอมให้มีการทับซ้อนเพียงเล็กน้อยซึ่งอาจทำให้เกิดข้อผิดพลาดเพียงไม่กี่กรณีในการถอดรหัส คุณจะได้การบรรจุที่หนาแน่น Hamming รับประกันระดับหนึ่ง; Shannon รับประกันเพียงความน่าจะเป็นของข้อผิดพลาดที่เล็ก แต่สามารถเข้าใกล้ความจุช่องทางได้เท่าที่คุณต้องการ ซึ่งรหัส Hamming ไม่สามารถทำได้

ทฤษฎีสารสนเทศไม่ได้บอกวิธีออกแบบให้ละเอียด แต่ชี้ทางสู่การออกแบบที่มีประสิทธิภาพ มันเป็นเครื่องมือที่มีค่าสำหรับวิศวกรรมระบบการสื่อสารระหว่างสิ่งที่เป็นเครื่องจักร แต่ดังที่กล่าวไว้ก่อนหน้านี้ มันไม่ได้เกี่ยวข้องโดยตรงกับการสื่อสารของมนุษย์มากนัก ตัวอย่างเช่น ยังไม่เป็นที่ทราบแน่ชัดว่าการถ่ายทอดทางชีวภาพเป็นไปในลักษณะเครื่องจักรมากเพียงใด และการนำทฤษฎีสารสนเทศไปใช้กับยีนจะเหมาะสมหรือไม่ จึงต้องทดลอง หากได้ผลแสดงว่ามีลักษณะเป็นเครื่องจักร แต่หากล้มเหลวจะแสดงให้เห็นแง่มุมอื่นของข้อมูลที่สำคัญ

เราจะสรุปสิ่งที่เราได้เรียนรู้ เราเห็นว่าคำนิยามเริ่มต้นทั้งหมด ควรในระดับหนึ่งได้สาระสำคัญของความเชื่อดั้งเดิมของเรา แต่พวกมันมักมีการบิดเบือนบางประการและจึงไม่สามารถใช้ได้เต็มที่กับสิ่งที่เราเคยคิดว่ามันเป็นตามที่เข้าใจโดยสัญชาตญาณ โดยปกติแล้วจะยอมรับในระยะยาวว่าคำนิยามที่เราใช้กำหนดสิ่งที่ถูกนิยาม แต่แน่นอนว่ามันบอกเพียงวิธีการจัดการกับสิ่งนั้นและไม่ได้บอกความหมายจริง ๆ วิธีการตั้งสมมติฐานเชิงพอสตุเลต (postulational approach) ซึ่งได้รับความนิยมในวงคณิตศาสตร์อาจไม่ตอบโจทย์ในการปฏิบัติ

ต่อไปเราจะหยิบตัวอย่างที่คำจำกัดความยังคงทำให้เราขบคิด นั่นคือ iq มันเป็นวงจรที่เป็นวงกลมตามที่คุณคาด การทดสอบถูกออกแบบมาเพื่อตรวจวัด “intelligence” ถูกปรับปรุงให้มีความสอดคล้องภายในมากที่สุดเท่าที่จะทำได้ แล้วเมื่อตั้งมาตรฐานโดยวิธีง่ายๆ ก็ประกาศว่าสามารถวัด “intelligence” ซึ่งต่อมามีการแจกแจงเป็นแบบปกติ (ผ่านเส้นโค้งการปรับมาตรฐาน) ทุกคำนิยามควรถูกตรวจสอบ ไม่ใช่เพียงเมื่อเสนอครั้งแรก แต่ควรทบทวนเมื่อเวลาผ่านไปเมื่อเห็นว่าพวกมันจะเข้ามาอยู่ในข้อสรุปที่ถูกดึงขึ้น ในระดับใดที่คำนิยามถูกตั้งขึ้นเพื่อให้ได้ผลลัพธ์ที่ต้องการ? บ่อยแค่ไหนที่คำนิยามถูกตั้งขึ้นภายใต้เงื่อนไขหนึ่งแล้วถูกนำไปใช้ในเงื่อนไขที่แตกต่างกันมาก? บ่อยครั้งที่สิ่งเหล่านี้เป็นจริง! และคงจะยิ่งเป็นเช่นนี้มากขึ้นเมื่อเราก้าวลึกเข้าไปในศาสตร์ที่อ่อนกว่า ซึ่งเป็นสิ่งที่หลีกเลี่ยงไม่ได้ในช่วงชีวิตของคุณ

สรุป: Thus one purpose of this presentation of information theory, besides its usefulness, is to sensitize you to this danger, or, if you prefer, to how to use it to get what you want! It has long been recognized the initial definitions determine what you find, much more than most people care to believe. The initial definitions need your careful attention in any new situation, and they are worth reviewing in fields in which you have long worked so you can understand the extent to which the results are a tautology and not real results at all.

มีเรื่องเล่าที่มีชื่อเสียงโดย Eddington เกี่ยวกับคนที่ออกไปตกปลาในทะเลด้วยตาข่าย เมื่อพิจารณาขนาดของปลาที่จับได้ พวกเขาตัดสินว่ามีขนาดปลาขั้นต่ำในทะเล! ข้อสรุปของพวกเขาเกิดจากเครื่องมือที่ใช้มากกว่าจากความเป็นจริง